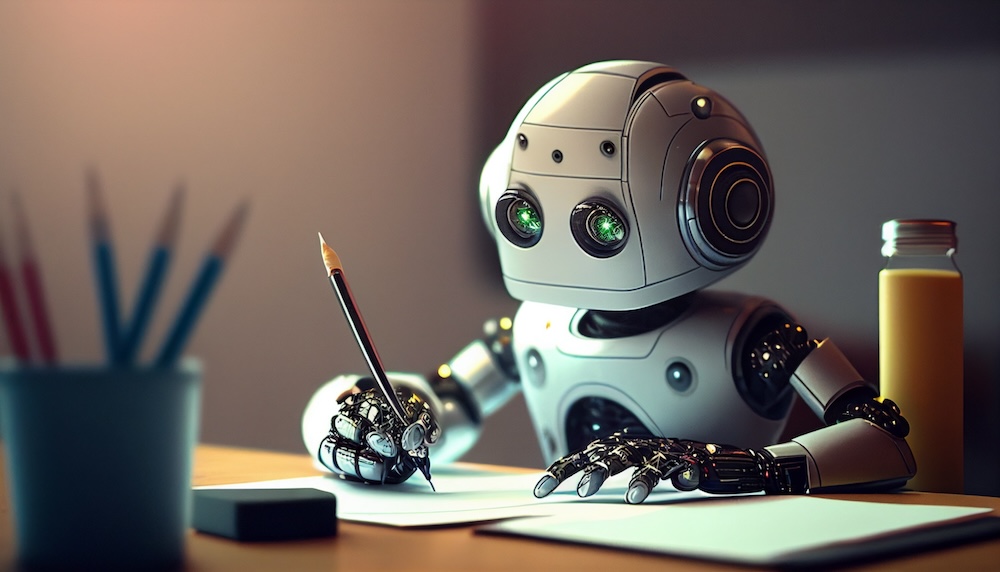

AI利用の法的リスク

和田倉門法律事務所 弁護士

野村 彩

「ChatGPT(チャットGPT)」などの対話型の生成型AI(以下総称して「ChatGPT等」)が急速に発展し、普及しています。ホワイトカラーにとっては、使いこなせば業務の生産性が劇的に上がるであろう反面、リスクも無視できないところです。本稿では、税務・会計業務を含むホワイトカラーにとってのChatGPT等の利用上のリスクのうち、特に重要と思われるものを3点ピックアップします。なお、ChatGPT等の大規模言語モデルは、この原稿を書いている今日この日においても、進化し続けているため、この論考はあくまで2024年6月時点のものであることをご了承いただけますと幸いです。

信頼性に関するリスク

ChatGPT等の仕組みは、入力された質問について、確率的な相関関係がありそうな単語を予測して文章を生成するというものです。いわば、「ありそうな」言葉を繋ぐ、という能力を持っているものです。

したがって、当然ながら、ChatGPT等の回答が「正しい」ものとは限りません。他方で、会計・税務・法律などの分野においては、「正しい」回答こそが重要であり、「ありそうな」回答では困ります。実際、先日、当職のもとにクライアントからこんなお尋ねがありました。「先生、ChatGPTによると、これこれこういう場合は取締役会決議が不要、とのことだったのですが、不要でよろしいでしょうか。なおChatGPTは、根拠となる文献もあげてくれました。『会社法大綱』だそうです。」とのことです。ですが残念ながら、その「これこれこういう場合」では取締役会決議が必要であり、また、『会社法大綱』という本は存在しませんでした。生成AIの精度は高まってきてはいますが、専門家が信頼を持って使う程度には達していないようです。

情報漏えいのリスク

本稿の読者層は、個人情報や厳格な機密情報を取り扱う方が多いと存じます。こういった情報をChatGPT等に入力すると、ChatGPT等がこの機密情報を学習に利用して、まったく関係ない第三者への回答に使われてしまうおそれがあります。実際、エンジニアが機密のソースコードをChatGPTに入力してしまうという事件も起きました。AppleやAmazonなどの複数の企業が現在、ChatGPT等の社内利用を制限しているのは、こういったリスクを考慮してのことでしょう。ChatGPTでは、会話の内容を学習させない「オプトアウト」を選択することもできますが、それを踏まえても、まだ流出のリスクが払拭されないというのが現状です。現時点では、利用の際は、万が一流出しても問題ない情報のみを会話に用いるべきと言わざるを得ません。いずれにせよ、企業で利用する場合は、社内規程の有無やその内容を常に確認する必要があります。また仮に流出した場合、社内規程や職務上の守秘義務違反のみならず、不正競争防止法上の営業秘密侵害罪に該当するリスクすらあります。さらに個人情報の場合、ChatGPTのプロンプトに個人情報を入力することが、個人情報保護法上の「第三者提供」に該当するのではないかという点も検証する必要があるでしょう。

著作権法侵害のリスク

著作権法との関係では、まず、ChatGPT等に質問をする場面、つまり、いわゆるプロンプトを入力する段階の問題があります。ChatGPT等に他人の著作物、例えば小説の一部分などを直接入力して、「これと同じような文章を作って」と依頼することは、著作物の複製にあたり、著作権者の許諾がない限り著作権法違反となる可能性があります。また、ChatGPT等が出力したものを利用する段階において、その生成物が他人の著作物と類似している場合は、それを利用することが著作権侵害になるかもしれません。この点は、従来の著作権の問題と同様になります。

生成AIはとても便利なものですが、新しい技術である故に、新しいリスクもまた存在します。リスクを認識した上で、上手に付き合っていきたいですね。

野村 彩

和田倉門法律事務所 弁護士

2007年から弁護士業務に従事し、企業法務・訴訟業務を中心的業務とする鳥飼総合事務所を経て、

同事務所より独立した和田倉門法律事務所にて業務を行う。株式会社GENDA(東グ) 社外取締役、

株式会社ACES (東京大学松尾研発AIスタートアップ企業)社外監査役、

株式会社アンドパッド 社外監査役、日本郵政グループ 内部通報制度 不服審査委員会 委員

(いずれも現任)。慶應義塾大学法学部卒業。立教大学法務研究科卒業。

弁護士、公認不正検査士(CFE)。